L’intelligence artificielle ne fait plus débat, elle s’installe. Sans fracas, sans résistance visible, elle glisse dans nos flux de travail, nos navigateurs, nos processus d’écriture et d’analyse.

Paradoxalement, l’utilisateur a le sentiment de gagner en puissance et en autonomie, de piloter ou du moins « co-piloter ». Mais cette maîtrise apparente cache peut-être une délégation subtile, où l’humain croit piloter un système qui, déjà, oriente ses choix. L’IA générative n’obéit plus, elle anticipe. Elle résume, organise, « génère », discrètement. Et si, ce faisant, elle prenait le contrôle ?

Dans ce nouveau Netsources, à travers l’analyse rigoureuse du prompting, des navigateurs agentiques, de la détection de contenu généré par IA et des obstacles culturels à son adoption, émerge en toile de fond, plus que jamais, la mutation profonde du rôle de l’humain dans un environnement « de plus en plus infusé par l’IA ».

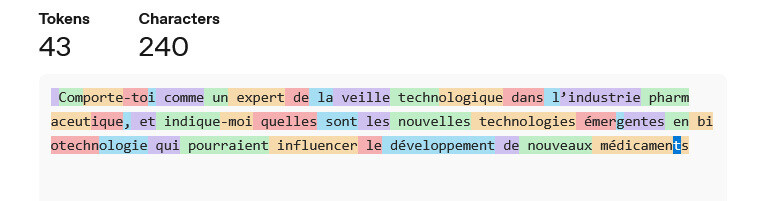

Poursuivant dans ce numéro son exploration du prompting, Véronique Mesguich le dépoussière : finies les recettes universelles, le prompt efficace est désormais une pratique contextuelle etitérative, taillée sur mesure pour chaque modèle et déjà tournée vers l’ère des agents autonomes, où la maîtrise ne réside plus dans la formule miracle, mais dans la compréhension fine du rôle, des contraintes et le dialogue continu.

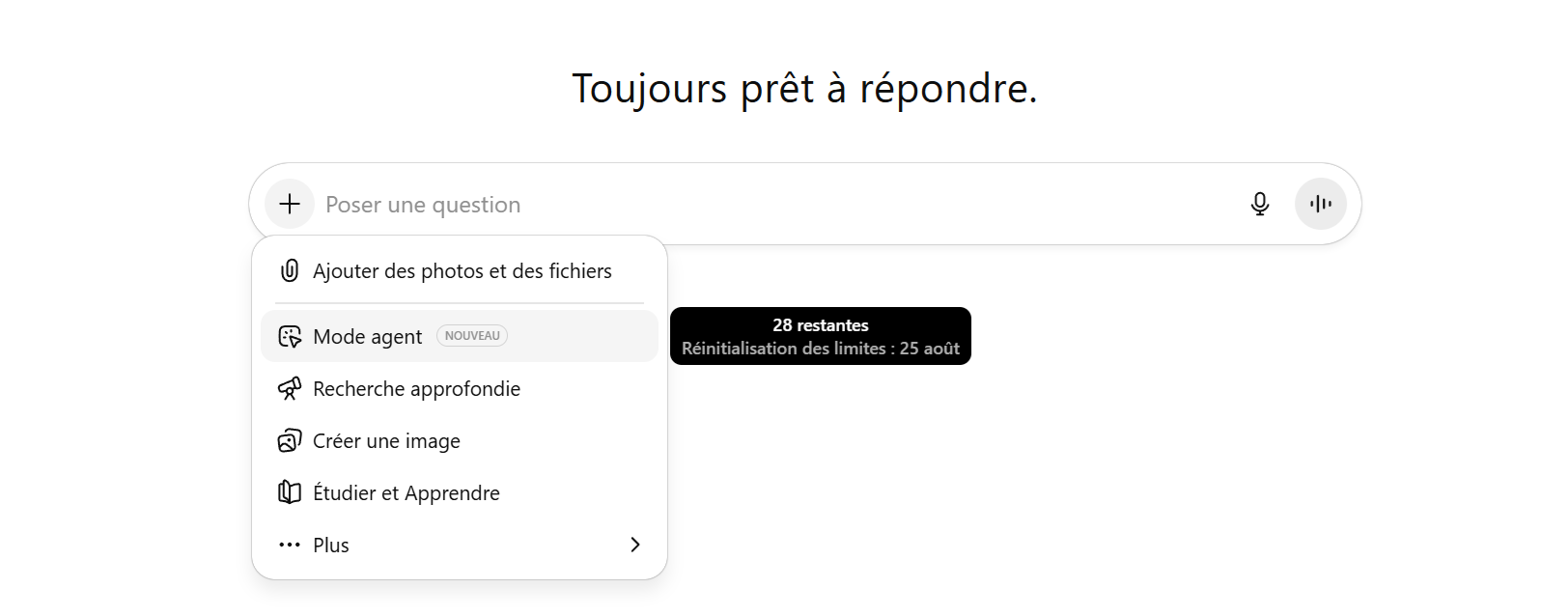

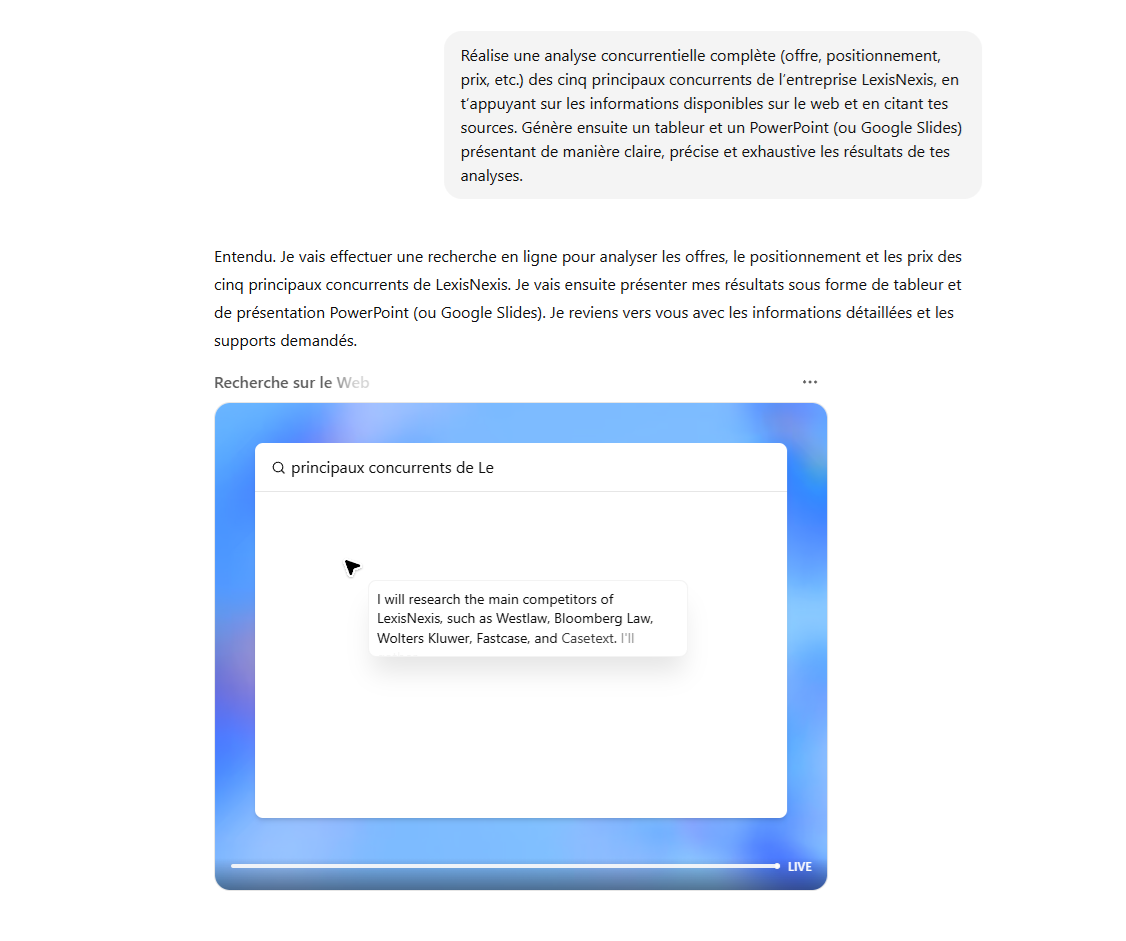

Ulysse Rajim, en testant Comet, le navigateur agentique de Perplexity, montre la rupture : l’outil ne répond plus, il agit - résume, ouvre des onglets, remplit des formulaires, réserve - souvent avant même que vous n’ayez validé l’étape. C’est là que le danger surgit : en exécutant sans demander à chaque fois, l’agent devient vulnérable aux instructions malveillantes glissées dans une page ou un résultat, expose vos données personnelles et professionnelles et transforme l’assistance ultrarapide en vecteur idéal de manipulation ou piratage des données.

De l’illusion de maîtrise du prompting à l’agent qui décide avant nous, le même vertige : Élodie Charrière nous révèle que les moteurs, noyés sous l’uniformité trop parfaite des textes IA, punissent désormais la fluidité excessive et font de l’imperfection humaine le dernier gage d’authenticité.

Christian Vigne clôt le numéro sur une pirouette aussi malicieuse que profonde : tant qu’on parlera encore d’« IA et… » (IA et santé, IA et écriture… ), on avouera qu’elle reste un corps étranger, un add-on qu’on saupoudre par-dessus les processus sans jamais le fondre dedans Et si, au fond, ce petit « et » de résistance était la plus belle manière de ne pas la laisser gagner ?

Au fond, la question n’est peut-être plus de savoir si l’IA nous assiste ou nous remplace, mais jusqu’où nous acceptons de lui déléguer sans comprendre. Entre gain d’efficacité et perte de discernement, le risque n’est pas seulement de céder le contrôle, mais d’oublier ce qu’il signifie.