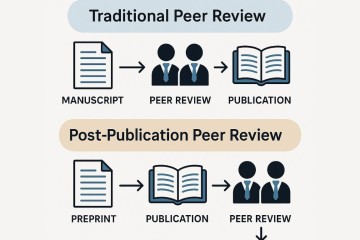

Le peer review d’un article académique est, traditionnellement, une revue par les pairs avant publication. Il reste le fondement du fonctionnement de la majorité des éditeurs, qu’ils publient selon le schéma traditionnel dans lequel le lecteur paie en s’abonnant, ou qu’ils publient en open access, schéma dans lequel l’auteur, son institution ou un sponsor règle les frais (Article processing charges, soit APC).

Les limites du peer review traditionnel

Si cette procédure est supposée garantir aux articles publiés un haut niveau de qualité, elle présente l’inconvénient majeur d’imposer un délai parfois long entre le dépôt du manuscrit et la publication effective de l’article.

Cela devient de moins en moins supportable alors même que les développements de la recherche connaissent une accélération significative comme on a pu le constater, en particulier, lors de la pandémie du COVID-19.

S’ajoute la difficulté croissante à trouver des reviewers (en règle générale bénévoles) disponibles, conséquence à la fois de l’inflation du nombre de publications et de la pression que subissent les chercheurs pour publier toujours plus, ce qui leur laisse moins de temps pour se consacrer aux reviews.

Et enfin, rien ne garantit que deux ou trois reviewers (au mieux) auront pu détecter toutes les failles potentielles d’un article. En effet, ces failles pourraient n’apparaître que lorsqu’un nombre plus important de scientifiques aura pu en prendre connaissance.

Les serveurs de préprints : première réponse aux défauts de l’édition traditionnelle

Compte tenu de cela, pour ne pas bloquer ou retarder la publication d’un article pouvant faire avancer la science (cf. encore l’épidémie du COVID-19), l’idée est apparue de créer des plateformes afin de publier l’article sans tarder (deux à quatre jours de délai), après quelques vérifications « de base » et, éventuellement, de le soumettre à un post publication peer review selon des modalités qui peuvent varier.

Une première réaction aux défauts de l’édition traditionnelle a donc été la création de serveurs de préprints (acception française de l’anglais preprint) qui hébergent et mettent gratuitement à disposition (en open access donc) les articles que leurs auteurs ont jugés être suffisamment aboutis pour être publiés en l’état sans attendre le résultat d’une peer review.

arXiv, le premier serveur de préprints créé en 1991 par des physiciens, a ouvert la voie. Sa couverture s’est largement étendue depuis.

Il existe aujourd’hui entre 60 et 70 serveurs de préprints dans le monde. Leur taille est variable, mais peut-être importante, et on note que les sciences de la vie au sens large sont particulièrement bien couvertes.

Il faut préciser que la grande majorité de ces serveurs de préprints n’offre pas de système structuré de peer review, qu’elle soit ou non ouverte à tous.